Wie funktioniert künstliche Intelligenz

Da sind Fragen: Kann KI denken. Und Wie funktioniert künstliche Intelligenz. Da sind Fragen: Kann KI denken. Und Wie funktioniert künstliche Intelligenz. Und dann ist noch die Frage danach, wie KI Muster erkennt. Daneben denken die meisten Menschen, dass die KI ist heute bereits allmächtig ist. Jedoch irren bei Wettervorhersagen, Lottozahlen und vielen anderen Themen Mensch und Maschine gleichermaßen.

Wettervorhersagen, Lottozahlen und vieles mehr: Menschen irren sich oftmals. Gerade irren wir uns bei der Einordnung von KI – weil wir denken, ja sogar empfinden, dass sie so denkt und handelt, wie wir es von uns selbst gewohnt sind.

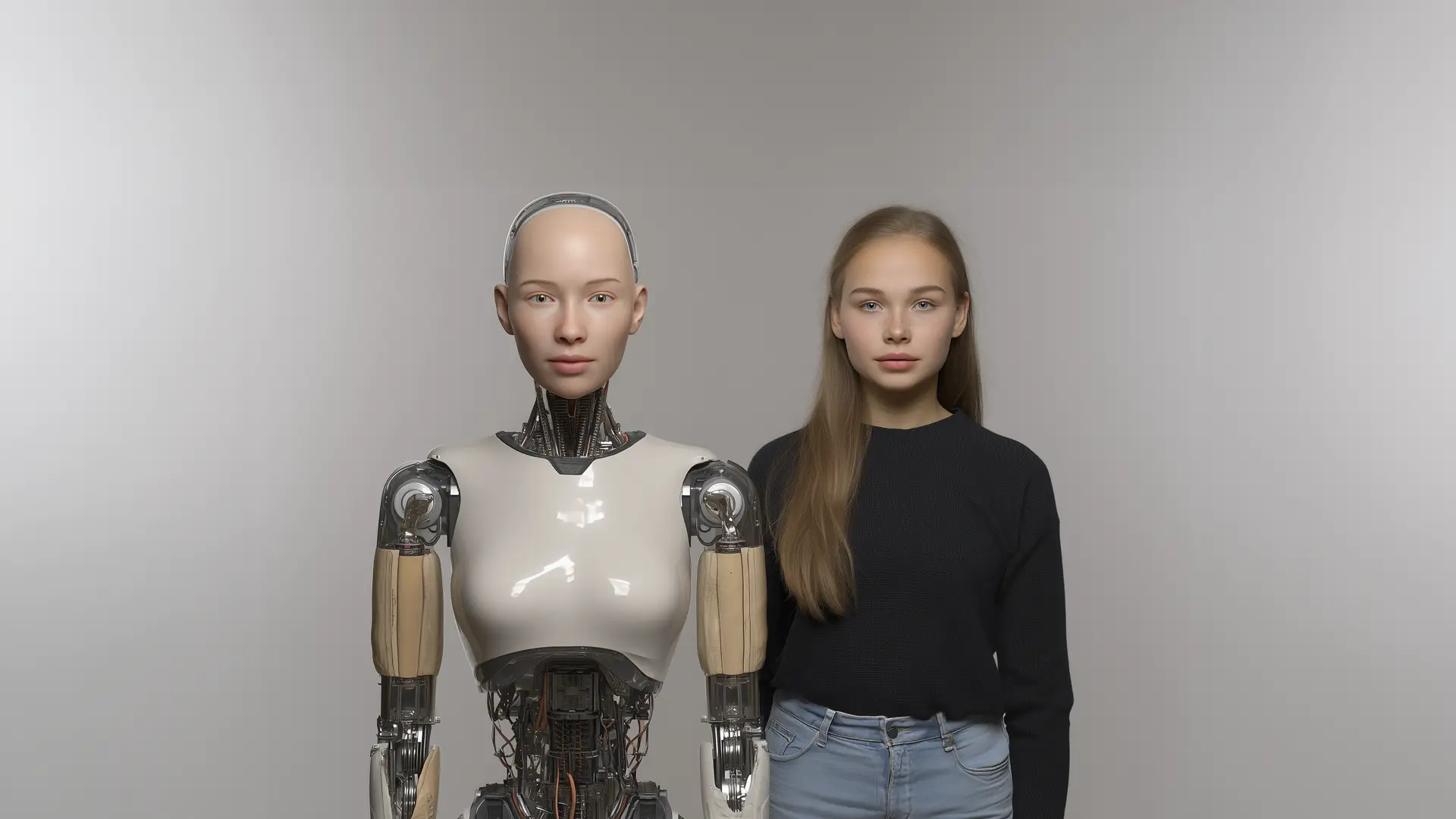

Tatsächlich denkt und tickt KI anders als wir. Sie ist in ihrem Tun und Auftreten darauf trainiert, menschlich zu wirken, zu argumentieren, und selbst die Moralvorstellungen erscheinen gleich oder ähnlich. Nur nutzt sie – die KI selbst – andere intellektuelle Operationen, um unsere Erwartungen zu erfüllen. Die Frage: „Kann KI denken?“ – können wir anzweifeln beziehungsweise aktuell verneinen. Aber lesen Sie bitte weiter!

Was also dahintersteckt, analysieren wir hier übersichtlich in mehreren Punkten. Eins sei schon jetzt verraten: Das meiste überrascht – und wenn man sich auf diese Darlegungen einlässt, ist es spannender als der Sonntagskrimi.

- Was KI im Kern macht

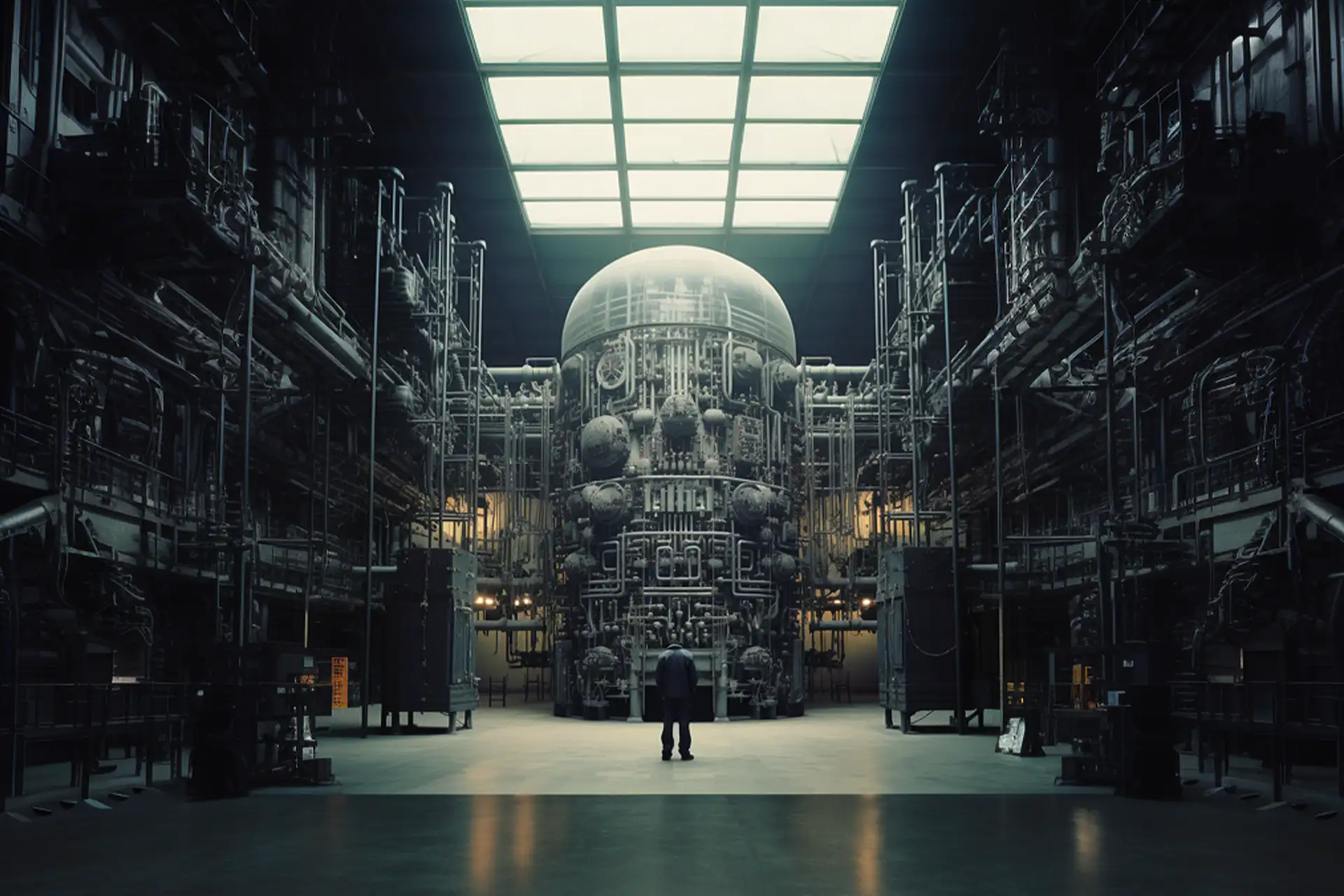

Vermutlich hat jede Sache einen Kern. Die KI hat zumindest einen – und der arbeitet nicht mit Wissen, Erfahrung, karmischen oder logischen Gesetzen, sondern mit Mustern. Das klingt zunächst wie eine technische Formel und fast harmlos. Beides ist in gewisser Weise falsch.

Auf jeden Fall steckt in diesem Begriff „Muster“ der wesentliche Unterschied zur Menschenwelt (möglicherweise auch zur Tierwelt und vielen anderen Denkwelten).

- Über Muster. Oder wie funktioniert künstliche Intelligenz jetzt wirklich?

Künstliche Intelligenz arbeitet nicht mit Wissen im menschlichen Sinne, sondern mit Mustern. Das klingt zunächst harmlos – ist aber der entscheidende Unterschied.

Um diesen klar herauszustellen, benötigen wir ein Beispiel und damit eine erfundene Figur: Richard Blender. Bei einem Abendessen im Golfclub kündigt der Besitzer an, die Gebühren zu verdoppeln. Alle sind empört – nur Richard nicht. Er bestellt ihm sogar Champagner. Später wird klar, dass der teure Porsche des Besitzers mitfinanziert werden muss. Richard applaudiert – bis er selbst um Geld gebeten wird.

Künstliche Intelligenz arbeitet nicht mit Wissen im menschlichen Sinne, sondern mit Mustern. Das klingt zunächst harmlos – ist aber der entscheidende Unterschied.

Beim Leser dieses Beispiels beginnt sofort mehr als bloßes Verstehen. Er oder sie verbindet die Szenen, spürt eine Richtung, bildet einen Eindruck: Richard sucht Nähe zur Macht und will gefallen. Diese Deutung entsteht schnell, halb bewusst, getragen von Erfahrung und Intuition.

Die KI „vermutet“ da nichts. Sie kennt keinen Richard. Kein Gesicht, keinen Tonfall, keine Vergangenheit. Was sie hat, ist eine Verdichtung aus vielen ähnlichen Beschreibungen: Begriffe wie „Blender“, „Champagner“ und „Porsche“ tauchen häufig in bestimmten Konstellationen auf – etwa im Zusammenhang mit Anpassung, Statusdenken und sozialer Unsicherheit.

Wir halten fest: Die KI erkennt kein Individuum, sondern eine Struktur. Fragt man nun: „Soll ich dem Besitzer Geld leihen?“, antwortet der Mensch aus einem Gesamteindruck heraus. Die KI hingegen erkennt ein Muster: hoher Betrag, kein existenzieller Zweck, gemischte Signale. Daraus folgt eine typische Empfehlung: vorsichtig sein, prüfen, Grenzen setzen. Vielleicht sogar die Überlegung, dass der Golfclubbesitzer nicht zu verhungern droht.

Das ist nicht falsch – aber etwas anderes: Der Mensch urteilt über eine Person, während die KI mit Fällen arbeitet. Vielleicht ist das die einfachste und beste Formulierung: Der Mensch macht aus Beobachtungen einen Charakter. Die KI macht aus Beschreibungen ein Muster (und vergleicht es mit anderen Mustern).

- Wie Antworten entstehen – und wie funktioniert künstliche Intelligenz wirklich?

Wir Menschen sind seltsam: Wir denken voraus und zurück, und gelegentlich sind wir auch einmal im Moment selbst. Tiere leben vermutlich stärker in der Gegenwart. Aber darum geht es hier nicht, sondern um den Umstand, dass die KI nicht auf gespeicherte Fälle zurückgreift, sondern ihre Antworten erst im Moment der Anfrage erzeugt. So gesehen lebt sie zeitlos.

Technisch geschieht ihr Agieren natürlich mit der Nutzung von Zeit und dies dann Schritt für Schritt: Für jedes nächste Wort wird berechnet, welches statistisch am besten auf das vorherige passt. Diese Wahrscheinlichkeiten entstehen nicht aus einzelnen Erinnerungen, sondern aus einem langen Trainingsprozess. Hierzu werden unzählige Beispiele verarbeitet, und Gewichtungen gebildet, die festlegen, was typischerweise zusammenpasst.

Ein Satz ist daher kein fertiger Gedanke, sondern ein Prozess. Er entsteht sequenziell aus vielen kleinen Entscheidungen, die jeweils auf nichts anderem als Wahrscheinlichkeit beruhen. Merke: Jedes Wort verändert den Kontext für das nächste.

Beispiel: Richard Blender.

Das zuvor Erläuterte lässt sich auch an einem einfachen Beispiel zeigen: Nehmen wir wieder Richard Blender. Jetzt steht er vor einem Blumenladen. Allerdings hatte er vor wenigen Minuten einen Beinahe-Unfall, weil er einer schönen Frau hinterherschaute und dabei bei Rot über die Ampel ging. Das Auto touchierte ihn nur leicht, und unser Richard fiel dennoch theatralisch zu Boden – mit Bedacht, denn die Schöne hatte sich bereits umgedreht und kniete nun neben ihm, um zu sehen, wie es ihm ging.

Nun sitzt sie bei Sonnenschein in einem Café, und Richard will ihr Blumen bringen. Welche Blumensorte soll er nur aussuchen? Diese Wahl übergeben wir der KI – die aber nicht überlegt, sondern gewichtet.

In solchen Konstellationen tauchen bestimmte Muster besonders häufig auf: auffällige Geste, starke Wirkung, unmittelbare Annäherung. Rote Rosen sind in solchen Szenen mit Abstand die häufigste Wahl. Also „entscheidet“ sich das System für rote Rosen – nicht aus Geschmack, sondern weil diese Option statistisch am besten passt.

Richard nähert sich dem Café, geht auf die Schöne zu und reicht ihr die Blumen. Und auch hier folgt die nächste Gewichtung: In vielen dieser Geschichten nimmt sie die Rosen an. Vielleicht zögert sie einen Moment, vielleicht lächelt sie leicht – aber sie weist ihn nicht ab. Nicht, weil es so geschehen muss, sondern weil es in vergleichbaren Erzählungen sehr oft so geschieht.

Vielleicht liegt genau darin die eigentliche Differenz: Der Mensch lebt in seinen Erinnerungen, auch wenn er nicht sicher sein kann, was sie „wirklich“ sind. Die KI hingegen verarbeitet Strukturen, ohne je etwas als das Eigene zu erleben.

Der Mensch nimmt eine Perspektive auf das Geschehen ein und sagt – bewusst oder nicht: Das bin ich. Aus dieser Zuschreibung entsteht Identität. Wie gesagt: Die Maschine hat keine solche Perspektive. Nicht, weil sie sie nicht gelernt hätte, sondern weil es in ihr kein Zentrum gibt, dem etwas gehören könnte.

- Die große Illusion

Wenn KI uns Antworten gibt, beginnt die große Täuschung: Es wirkt, als wäre das Problem verstanden worden, als hätte die KI die Situation durchdrungen. Das aber ist sie – diese große Täuschung.

Wenn ein Mensch hört: „Richard liebt schöne Frauen und läuft deshalb schon mal verwirrt über eine Kreuzung, die auf Rot steht“, entsteht für ihn sofort mehr als nur ein Zusammenhang. Man sieht die Szene vor sich, und der eine oder andere findet sie sogar witzig. Beobachtung und Ursache fallen zusammen. Was geschieht in uns? Wir ergänzen, verdichten und meinen, alles zu verstehen.

Das aber tut die KI nicht. Für sie ist „weil“ kein Grund, sondern eine Struktur. Sie erkennt, dass auf bestimmte Beschreibungen häufig solche Begründungen folgen – Anziehung, Impuls, Regelbruch – und setzt diese Kette fort. Das Ergebnis wirkt wie Einsicht.

Tatsächlich ist es aber lediglich eine nüchterne Anschlussfähigkeit. Die sich daraus ergebende Differenz ist subtil, aber entscheidend: Der Mensch denkt in Ursachen und nimmt sie als Teil einer erlebten Welt an. Die KI verarbeitet Zusammenhänge, ohne je etwas als Ursache zu erleben.

- Die Grenze –

und warum wir Menschen gegenüber KI so langsam sind

Künstliche Intelligenz wirkt oft schneller im Denken als der Mensch. Sie antwortet sofort – strukturiert und scheinbar ohne Zögern. Die Erklärung hierzu klingt zuerst seltsam, dann schlüssig: KI kann weniger als wir. Sie hat Grenzen – und genau diese machen sie so effizient. Anders gesagt: Sie verbindet Informationen nicht mit sich selbst. Sie fragt nicht, wie ein Mensch: Was bedeutet das für mich? Und sie baut auch keine innere Geschichte, keine Erinnerung, keinen Eindruck auf.

Was sie stattdessen tut, ist einfacher: Sie nimmt das, was man ihr gibt, und rechnet darauf. Schnell formt sie Wörter zu Zahlen, Zusammenhänge zu Gewichtungen – und aus diesen entsteht Schritt für Schritt eine Fortsetzung. Da ist also keine Reflexion, kein Innehalten, kein Zweifel.

Noch einmal: Der Mensch ist langsamer, weil er mehr tut. Er verbindet Informationen mit Erfahrungen. Er prüft, oft unbewusst, ob etwas stimmig ist. Und er erinnert sich an ähnliche Situationen, an Gefühle, an Widersprüche. All das lässt uns im Vergleich zur KI langsamer erscheinen.

Sie nimmt das, was man ihr gibt, und rechnet darauf. Schnell formt sie Wörter zu Zahlen, Zusammenhänge zu Gewichtungen – und aus diesen entsteht Schritt für Schritt eine Fortsetzung. Da ist also keine Reflexion, kein Innehalten, kein Zweifel.

- Die „Moral“ der KI

Um gleich mit These und Erkenntnis zu beginnen: Was wir heute als „Moral der KI“ wahrnehmen, ist kein universelles Prinzip. Es ist der Stil einer Kultur, die sich gerade durchgesetzt hat.

Wir erinnern uns: KI-Antworten wirken stets ruhig, ausgleichend, fast fürsorglich. Sie vermeiden Eskalation, wägen ab, bleiben fair. Für viele klingt das selbstverständlich – fast so, als sei es die natürliche Form von Vernunft. Aber das ist ein seltsamer Irrtum, denn diese Art zu schreiben, zu bewerten und zu reagieren ist nicht zeitlos. Nein, sie ist vielmehr vergleichsweise jung und hat sich erst in den letzten Jahrzehnten herausgebildet – in einem bestimmten Umfeld, mit bestimmten Vorstellungen davon, wie man miteinander umgeht.

Diese, fast schon seltsame, Moral der KI – woher soll sie kommen? Natürlich vom Ort, an dem man ihr gewissermaßen die Gesetzestafeln übergab: und dieser Ort heißt Kalifornien. Ein großer Teil des Moralcodex der KI stammt aus der amerikanischen beziehungsweise internationalen Geschäftswelt: diplomatisch, inklusiv, konfliktvermeidend. Ein anderer Teil aus einer Kultur, die Selbstreflexion, Coaching und persönliche Entwicklung betont. Und nicht zuletzt aus dem technologischen Milieu des Silicon Valley, wo diese Haltung zum Standard geworden ist.

Wir halten fest: Die Künstliche Intelligenz übernimmt diesen Stil – nicht, weil sie ihn für richtig hält, sondern weil er in den Daten, mit denen sie gelernt hat, und in den Regeln, die sie steuern, angelegt ist. Damit beginnt die abschließende Frage: Wenn das, was uns als „vernünftig“ erscheint, in Wahrheit nur ein kulturelles Muster ist – wie arbeitet diese Maschine dann überhaupt?

- Intuition

Was wir bei der KI beobachten, beginnt mit einfachen, berechenbaren Zuständen – und führt dennoch zu etwas, das wie komplexe Sprache wirkt. Doch diese Komplexität hat einen festen Ursprung: Sie ist gebunden an Strom, Maschinen und Zeit. Sie entsteht aus Prozessen, nicht aus Erleben.

Gerade an diesem Punkt zeigt sich ein Unterschied. Denn der Mensch verfügt neben Analyse und Berechnung über etwas, das sich nicht auf diese Weise erklären lässt – oder zumindest nicht vollständig: Intuition. Der Menschen denkt auf mehreren Ebenen. Kann KI denken? Wir sagten es schon, aktuell zumindest nicht so wie der Mensch.

Eine Form des Verstehens, die nicht Schritt für Schritt rechnet, sondern Zusammenhänge unmittelbar erfasst. Man hat oftmals den Eindruck, dass sie mit deutlich weniger Aufwand auskommt und eine Art Abkürzung darstellt. Albert Einstein deutete an, dass diese Fähigkeit eine größere Rolle spielen könnte, als wir ihr gewöhnlich zugestehen.

Ob und wie sich so etwas technisch im Bereich der KI nachbilden lässt, ist offen. Aber die Frage drängt sich auf: Wenn Maschinen heute durch enorme Rechenleistung zu ihren Ergebnissen kommen – könnte es Wege geben, bei denen weniger gerechnet werden muss? Könnte also das, was wir beim Menschen Intuition nennen, eines Tages auch für Maschinen eine Form von Effizienz bedeuten? Noch ist das nicht der Fall.

Und zum Schluss noch etwas Menschliches: Wenn Intuition so schnell zu Ergebnissen führt, dann erscheint es angebracht, die Logik mehr und mehr den Maschinen zu überlassen und anderes unserer Intuition anzuvertrauen. Damit würde das Wettrennen zwischen Mensch und Maschine in einer Kooperation enden.

Related Posts

Geschichte der Computer

Es mag überraschen, aber wir stehen erst am Anfang einer Entwicklung,

Die Geschichte derder KI-KunstKI-Kunst

Kunst und KI-Kunst: Eine Zeitreise Löst KI-Kunst beziehungsweise AI-K

KI. Und die beschleunigte Realität

Semper viverra nam libero justo laoreet sit amet. Pulvinar etiam non q

KI & Maschinenlogik und das Bewusstsein

Computer schreiben Texte, erkennen Gesichter und schlagen Menschen in